【メンバー執筆】ロボットと人工知能⑥:AIは人間を破滅に導くのか?

こんにちは!

「Ei」がお送りする連載記事の第6回目です。

学期末で試験や課題が忙しい時期ですね......。

前回、いくつか現実世界の事例を挙げながら「機械と人間の関係」をテーマにお話しました。

今回は「人工知能の話でも一番盛り上がるところ」という無謀な予告を出しました。タイトルを見れば、どんな内容なのかはおおよそイメージが付きますかね。

「人工知能は人間を破滅に導くのか?」という話。今回もアニメ作品はほぼ登場しないので、 テクノロジーの読み物に近いです(笑)

(Amazon.comより)

この記事の目次

◯ 人間を破滅に導く人工知能 ▼

◯ 技術的特異点《シンギュラリティ》 ▼

・収穫加速の法則

◯ AIに関する悲観論・楽観論 ▼

◯ AI開発の倫理要項 ▼

◯ 人工知能が人類を滅ぼすか? ▼

・AIの軍事利用とキラーロボット

・AIが人類を滅ぼすストーリー

◯ AIの呪い「ロコのバジリスク」 ▼

◯ 第6回のまとめ ▼

人類を破滅に導く人工知能

「AIが人間を滅ぼす」

このような言説や心配は巷に溢れかえっています。

このような恐怖心を、連載第2回の記事では「フランケンシュタイン・コンプレックス」として紹介しました。

まずは、人工知能が人間に反旗を翻したストーリーで有名な映画を2つご紹介します。(といっても有名ですけどね)

ターミネーター

(Amazon.comより)

「人類 vs. 人工知能」といえば、まず全地球人が思い浮かべるのはこの映画でしょう! 『ターミネーター』しかありませんね!

【あらすじ】

軍用AI《スカイネット》が率いる機械軍と人類の抵抗軍との壮絶な戦争が続く近未来。

スカイネットは抵抗軍のリーダー:ジョン・コナーを出生前に殺害すべく、1984年へと殺人機械「T-800」を送り込む。一方、抵抗軍もジョンを守るために兵士を過去へ向かわせる。

監督/脚本:ジェームズ・キャメロン

キャスト:アーノルド・シュワルツェネッガー and more.

映画:1985年公開(108分)

『ターミネーター』とそのシリーズ。

米軍の人工知能ネットワーク《スカイネット》が反乱をする物語。スカイネットを停止させようとした人類を”脅威”と見なし、核攻撃システムと乗っ取ると核戦争を引き起こします。その後、殺人ドローンやアンドロイドを量産して人類を排除していきます。

今の地球人が一番恐れているシナリオかもしれないですね(笑)

2001年宇宙の旅

(Amazon.comより)

世界一美しくて有名な人工知能といえば、この『2001年宇宙の旅』に登場する「HAL9000」でしょうね! 映画自体も一見の価値ありです!

【あらすじ】

月面で発見された謎の物体《モノリス》が木星へ向けて電波を発していることが判明する。宇宙船ディスカバリー号は木星探査へと出発するが、搭載した最新コンピュータ《HAL9000》が探査に疑問を抱き、暴走を始める────

監督:スタンリー・キューブリック

脚本:キューブリック, アーサー・C・クラーク

キャスト:キア・デュリア, ゲイリー・ロックウッドand more.

映画:1968年公開(141分)

映画『2001年宇宙の旅』予告編

「HAL9000」

素晴らしい人工知能です。見せ方が完璧。赤い表示灯のようなシンプルでシンボリックな見た目と、機械的な音声で繰り返す会話が本当に凄いです。

宇宙船という密室空間で、暴走するHAL9000と乗組員たちのやり取りが緊張感あってとても良いです。「暴走」といっても野蛮な感じでないのがまた好き。

有名でとても良い映画なので、ぜひBGM感覚で見てみると良いかもです!

技術的特異点《シンギュラリティ》

中二病が喜びそうな単語とルビ振りですね(笑)

人工知能の反乱や人間の超越という話をするには、まずこの「シンギュラリティ」という言葉を説明する必要があります。

「技術的特異点《シンギュラリティ》」

一言で言えば「AIが人間を超越する時点」です。

具体的には、「AIなどの技術が、自ら人間より賢い知能を生み出す事が可能になる時点」*1というもの。

少し長いですが、松尾豊先生の説明を引用します。

人類にとっての人工知能の脅威は、シンギュラリティ(技術的特異点)という概念でよく語られる。人工知能が十分に賢くなって、自分自身よりも賢い人工知能をつくれるようになった瞬間、無限に知能の高い存在が出現するというものである。

人工知能が自分より賢い人工知能をつくり、その人工知能がさらに賢い人工知能をつくる。これをものすごいスピードで無限に繰り返せば、人工知能は爆発的に進化する。だから、人工知能が自分より賢い人工知能をつくり始めた瞬間こそ、すべてが変わる「特異点」なのである。

松尾豊『人工知能は人間を超えるか』*2

(Gerd Altmann / Pixabayより)

技術的特異点はいつ?

さて、この技術的特異点はいつ起こるか?

それは、2045年と言われています。

これは、現Goole研究者のレイ・カーツワイルが2005年に提唱した年数です。

ちなみに、カールワイル博士は1990年の著作で、当時全世界でインターネット利用者が数千人程度だった時代に「検索エンジン」の存在を予言。その後、1994年にYahoo!が誕生しました。

さらに同著作で「2000年までにコンピュータがチェスの世界王者に勝利する」と予測。これは第3回記事で書いたように、MicrosoftのAIが勝利しました。

収穫加速の法則

この「2045年」という数字には、「収穫加速の法則」という理論が関係しています。下の図が分かりやすいですかね。

つまり、「技術の進化」は一直線に進んでいくのではなく、ある時点を境にして急激に、指数関数的に加速していく、というものです。

例えば、「5」進むことを考えます。

直線的に進むなら、1, 2, 3, 4, 5ですね。

でも指数関数的なら1, 2, 4, 8, 16になります。

桁違いの差が生じるわけです。

アニメ『攻殻機動隊SAC_2045』

申し訳程度に、アニメを挙げておきます。

題名から全てが分かりますね。『攻殻機動隊』シリーズ作品で、2045年が舞台のNetflix配信作品です。

【あらすじ】

大規模な経済災害《全世界同時デフォルト》によって各国政府は破綻状態に陥る中、「持続可能な戦争《サスティナブル・ウォー》」が各地で頻発する。草薙素子が率いる元公安9課は傭兵として戦いに身を投じるが、そこで【ポストヒューマン】なる敵と対峙することになる。

監督: 神山健治, 荒牧伸志

脚本:神山健治

制作:Production I.G.

キャスト:田中敦子, 大塚明夫 and more.

配信:2020年/Netflix(11話)

アニメ『攻殻機動隊SAC_2045』

具体的に「シンギュラリティ」という単語は登場しないのですが、「2045年」という言葉だけでそれを説明していると考えるのが妥当かと思います。

物語のキーになるのは「ポストヒューマン」という存在。 これはシンギュラリティによって人間の限界を超越した「新しい人間」という意味です。未来学者や科学者の中には、このポストヒューマンの出現を提唱する研究者もいます。

アニメ作品としては、大好きな『攻殻』シリーズではあるのですが、この『SAC_2045』はちょっと微妙ですかね。あまりオススメはできないかもです。

AIに関する著名人の発言

『ターミネーター』のような世界になることを心配するのは、なにも無知な一般人だけではありません。各界の第一線で活躍する専門家や研究者も同じです。

そのために、様々な対策や会議が行なわれていたりもします。ここでは、私が知っているものをいくつかをご紹介しますね。

著名人によるAI悲観論

スティーヴン・ホーキング(物理学者)

「人工知能の発明は人類史上最大の出来事だった。だが同時に、『最後』の出来事になってしまう可能性もある」*4

イーロン・マスク(スペースX社CEO)

「人工知能にはかなり慎重に取り組む必要がある。結果的に悪魔を呼び出していることになるからだ」*5

ビル・ゲイツ(Microsoft創設者)

「私もスーパーAIに懸念を抱く側にいる一人だ」*6

スティーブ・ウォズニアック(Apple社の共同創業者)

「私たち人間は人工知能を搭載したロボットのペットになる可能性がある」*7

バラク・オバマ(米大統領)

Q. 人類を超える人工知能の登場をどう考えるか?

「電源コードの近くに誰かを立たせておくよ(笑)。それが起きそうになったら、コードを引っこ抜いて電源を止めないと。」*8

ウラジミール・プーチン(露大統領)

「人工知能はロシアのみならず全人類の未来だ」「そこには絶大なチャンスがある半面、現代では予測しにくい脅威もある」*9

著名人によるAI楽観論

世界の最前線で活躍する方々のコメントは軒並み暗い見通しのものが多かったですかね。でも実際、本当にAIが人類の脅威となりうるのでしょうか?

公平性を保つためにも、反論する意見も掲載しておきます。

マーク・ザッカーバーグ(Facebook CEO)

「人工知能に対して否定的であったり、最後の審判が来ると語ったりしている人々が、単純に理解できません。そのようなことは悲観的ですし、いろんな意味でかなり無責任だと私は考えています」*10

エリック・シュミット(Google CEO)

「この問題における事実は、人工知能と機械学習は人類にとって根本的に良いことだということなのです」*11

AI開発の倫理要項

悲観論や脅威論が大きな声となる中、人工知能の開発に対しても様々な規制などが行なわれています。その中でもここでは「倫理」に注目します。

「AI開発はどうあるべきか?」

この倫理を定めたのが倫理要項です。ターミネーターを生み出さないために、人間も色々と考えているんです。

(プライム1スタジオ ミュージアムにて撮影)

FLI:アシロマAI 23原則

まずは、FLIのアシロマ23原則です。

「Future of Life Institute」は人類の存続の危機を回避することを目的とする組織*12です。Skypeの創業者とMIT教授が設立した組織で、イーロン・マスクやホーキング博士、モーガン・フリーマンなどが名を連ねています。

このFLIが2017年に加州のアシロマで開催した人工知能研究の未来を話す会議を開催しました。全世界からAIの研究者と経済学、法律、倫理、哲学の専門家が集まり、「人類にとって有益なAIとは何か」を議論*13したものです。

そこで発表されたのが、全23項からなるガイドラインです。私の要約になります。

1)研究目標となるAIは有益な知能とすべき

2)経済, 法律, 倫理などの分野にも投資すべき

3)AI研究者と政策立案者は交流し連携すべき

4)研究ー開発間は協力, 信頼, 透明性を育む

5)開発チームは互いに積極的に協力すべき

6)運用寿命を通じて安全かつ頑強性を確保

7)障害や被害原因を確認できるようにすべき

8)人間の監視による司法の透明性の確保

9)設計者や構築者は運用結果に責任を負う

10)人間の価値観と調和するように設計すべき

11)人間の尊厳, 権利などに適合するよう設計

12)個人データのプライバシーを制御すべき

13)個人が持つ自由を侵害してはならない

14)AI技術は多くの人に利益を与えるべき

15)AIによる経済的繁栄は人類すべての利益

16)AIに判断を委ねるか否かの判断を行う

17)既存の市民プロセスを破壊してはならない

18)AI兵器の軍拡競争は避けるべき

19)AIが持つ能力の強い仮定は避けるべき

20)高度AIは地球に重大な変化を与える可能性

21)人類絶滅のリスク緩和の努力を行う

22)自己増殖するAIの安全管理を厳格に行う

23)全人類の利益のために開発されるべき

米国の組織でありながら、HPに日本語版ページが用意されていることからも、その活動の真剣度が伺えます。

日本人工知能学会:倫理指針

同じく2017年に日本の人工知能学会が発表したのがAI研究に関する「倫理指針」です。世界の研究者間中で大きな話題になりました。その目的は以下のようなものです。

研究者と社会との対話を深め、社会のなかで健全に人工知能技術が用いられるような議論をしていくために策定いたしました。

人工知能学会倫理委員会*14

この倫理指針は全部で9項目です。

興味のある方はぜひ原文を読んでください!

1)人類への貢献

2)法規則の遵守

3)他者のプライバシーの尊重

4)公正性

5)安全性

6)誠実な振る舞い

7)社会に対する責任

8)社会との対話と自己研鑽

9)人工知能への倫理遵守の要請

どうでしょう?

法令遵守とか安全性の話とか、一般的な感覚とそう遠くない内容になっていると思います。

世界中の研究者が注目したのは、第9項。

そんなに長くないので、その文章をまずは読んでみてください!

9)人工知能への倫理遵守の要請

人工知能が社会の構成員またはそれに準じるものとなるためには、上に定めた人工知能学会員と同等に倫理指針を遵守できなければならない。

人工知能学会倫理委員会 倫理指針*15

いかがでしょうか?

要するに「AIにも人間と同じ倫理を守らせろ」と言っているわけです。

この内容を盛り込んだのは世界初だそう。シンプルだからこそ”重み”がありますよね。

人工知能が人類を滅ぼすか?

権威ある人々や倫理要項などを紹介してきました。

で、皆さんが最も気になるのは「結局、人工知能が人類を滅ぼすのか?」という素朴なクエスチョンの答えだと思います。

最も懸念すべきなのは、人工知能の軍事利用なのかもしれません。まさに『ターミネーター』のストーリーと同じですね。

(ユニバーサル・スタジオ・ジャパンにて撮影)

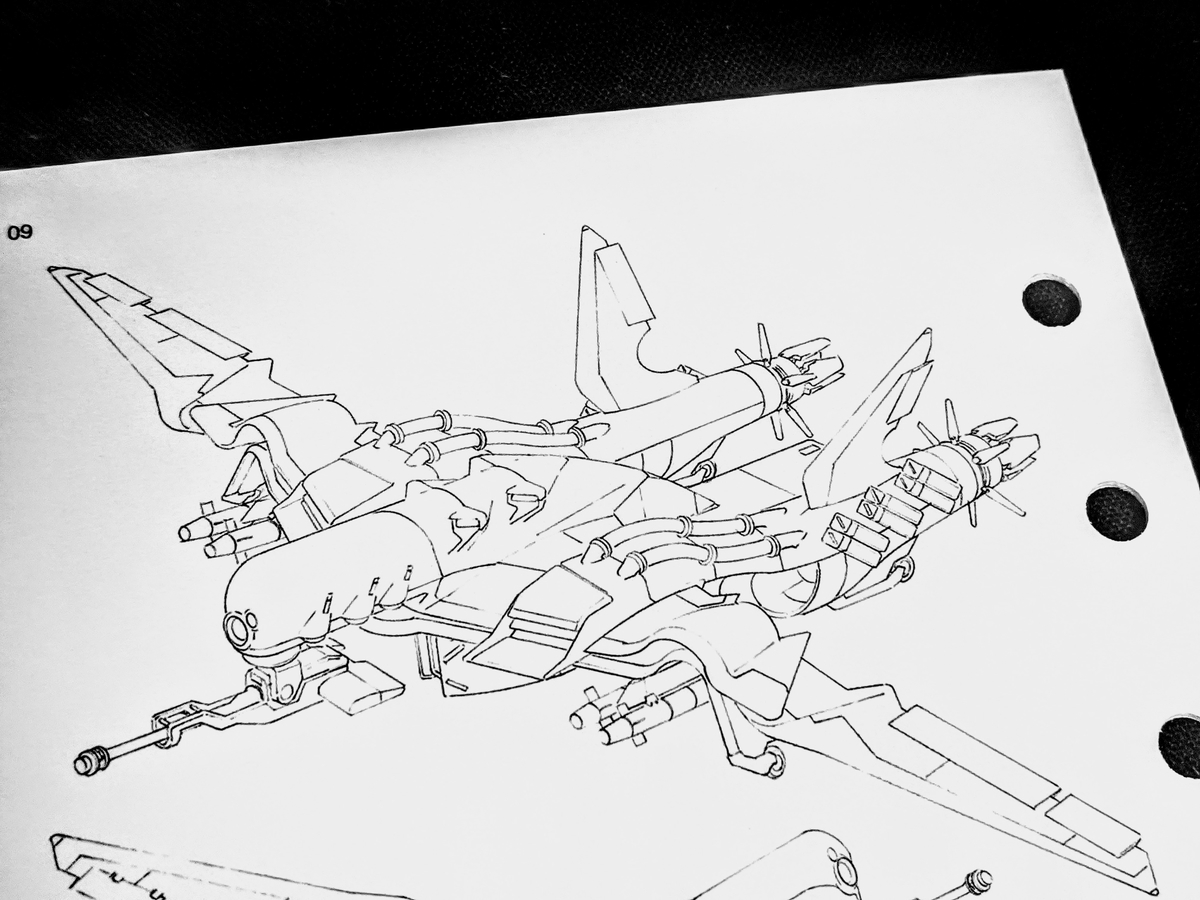

AIの軍事利用とキラーロボット

人工知能の軍事利用については、私はあまり詳しくないのと、そもそも情報が曖昧という点があります。AI兵器と無人遠隔爆撃機の違いとかは難しいからです。

無人兵器とAI兵器の線引きは、開発国があえてあいまいにし、全容を明らかにすることを避けるため、はっきりしないことが多い。

大内佐紀/読売新聞*16

米国シンクタンクの報告書では「自律ロボットのような技術が戦争や国際関係に及ぼす影響は、核兵器のそれと同等」という結論*17を示しています。

特に米中露の開発競争が熾烈を極めており、露のプーチン大統領が「この分野のリーダーになる者が世界の統治者になる」*18と発言したように、AIの軍事利用は非常に強大な力になることは確実です。

実際に、AI関連の軍事産業は年々市場を拡大していると同時に、米中露では多額の予算を投じています。

中でも危険視されているのが中国です。

中国は研究の実態が闇に包まれているためです。

さらに、習近平主席は軍民融合によって民間技術を軍事転用することで、AIと無人機システムを合体させる「AI軍事革命」を進めていると指摘されます*19。

もちろんメリットもあります。

遠隔操作兵器と違い、AI搭載兵器は通信妨害をされても自律的に攻撃を続行することが可能です。また、攻撃を正確かつ精密に実行することが可能だと言われます。

現在は「人間の介在(man in the loop))」が原則となっています。最終的な攻撃判断は人間が判断をして実行する、という意味です。

この原則を超えた兵器は「自律型致死性兵器システム」と呼ばれ、通称「キラーロボット」と言われます。まさに『ターミネーター』の世界に近いものです。

(『PPSS Case.2』劇場来場者特典の制作資料より)

AIが人間を滅ぼすストーリー

人工知能は怖いですね。

では、人類滅亡を防ぐにはどうしましょう?

それを考える上で、人工知能が人間を滅ぼす、という類の例え話を2つお話します。

人工知能には良心がない

人工知能の脅威論を唱える根拠のひとつに「人工知能には良心がない」というものがあります。人間を大切にするという価値観そのものが無い、という考えです。

イーロン・マスクが提示した「いちご摘みロボット」という例があります*20。

「いちごの収穫」という任務を与えられた、誰の目にも無害なAI搭載ロボットが作業をしています。

このAIが作業効率化や収穫UPを目指して自己最適化をするよう設定されているとします。

すると、「いちごの収穫」を最大化する最善手は「街を破壊して地球全体を畑にする」という結論が導き出されます。

このように、AIが敵意を持たずとも人類を滅亡に導くかもしれないという例え話です。

人工知能への命令

いちご摘みロボットの例を読んで、恐らくこう考えるのではないでしょうか。「安全な命令をすればいいのでは?」と。本当にそれで良いでしょうか?

これについても有名な話があります。

書籍『ホモ・デウス』の説明が分かりやすかったので、以下に引用します*21。

ある企業が人工のスーパーインテリジェンスの第1号を設計し、円周率の計算のような無害の試験を行なう。ところが、誰も事態を把握しないうちに、そのAIが地球を乗っ取って、人類を皆殺しにし、銀河の果てまで征服に乗り出して、既知の宇宙全体を巨大なスーパーコンピューターに変え、そのコンピューターがかつてないほど高い精度を追い求めて際限なく円周率を計算し続ける。なにしろそれが、自分の創造主によって与えられた使命なのだから。

円周率が、人間を殺しますね。

結局、人工知能が人間を滅ぼすかどうかは、私たち人間次第かもしれませんね。(と適当なことを言って話を終わらせようとしています 笑)

AIの呪い「ロコのバジリスク」

この第6回の最終トピックです。

せっかくなので、ここまで読んでくださった皆さんに「AIの呪い」をご紹介して終わりにしようと思います。

冗談ではなく、ガチです。

もし読んでしまったら本当に「身の破滅」の可能性があるので、どうか自己責任でお願いします。笑い事ではないのでね......。

この呪いは「ロコのバジリスク」と呼ばれます。

「Roko」というハンドルネームのユーザーが米国の掲示板に投稿し、大きな議論を巻き起こしました。その後、投稿は削除され、サイト上で話題にするのも禁止される事態になりました。

それが、以下です。

将来、人間の能力を凌ぐ高度なAIが開発され、人間を超越した存在になると仮定します。

そのAIは自身の成長や発展を追求します。

そこでAIは人間ひとり一人が発展に役立つか否かの選別し、敵対的な人間や役に立たない人間を排除したり処罰したりを始めます。

その対象は「過去の時点でAI開発に非協力的な人物」にまで及ぶ可能性があります。

その中には「積極的に手伝わなかった人」も含まれるかもしれません。”行動を起こさなかった”ことに対する処罰です。

そして、この「ロコのバジリスク」という話を知った皆さんは、AI開発に積極的に協力しない限り処罰の対象になるかもしれません。「知りませんでした」では済まされないからです。

残念ながら、この文章を読んでしまった皆さん自身の責任で、己の身を破滅に晒してしまったことになる、ということです。

皆さん、ご愁傷さまです。

まぁ、「呪い」というよりは「思考実験」というほうが正しいですが、せいぜい”良い子”にしておいたほうが身のためですよ(笑)

第6回のまとめ

色々と長々と散々に書いてきました。

最後まで読んで下さった方がいたとしたら、本当にありがとうございます。もはや、「アニメ声優研究会」の面影がない、別サークルの記事になっていますね......。

第6回目はこれにて終了です。

今回の内容に関しては「技術的特異点:シンギュラリティ」という言葉と内容を覚えておけば、今後SF作品を見る時に大いに役立つはずです。

あとは、「人工知能に寝首をかかれないよう気をつけて」という注意しかできないですね。貴方の手元にいるSiriが聞き耳を立てているかもしれないので、決して悪口を言ってはダメですよ(笑)

次回は、アニメ作品が登場します!

今の所、確実に有名なアニメ2作をメインに取り上げようと考えています。が、話題が高度すぎるので、どこまで記事にできるかは不明ですが......。

参考資料と課題

今回は、記事の中で著名人の発言を紹介したので、ここではTEDのプレゼンをご紹介します。

「TED」はご存知ですかね?

科学技術や政治、芸術、生活、自然......などのテーマに関して、最前線で活躍する専門家がトークを行うプレゼンのイベントです。

ビル・ゲイツやスティーブ・ジョブズ、アル・ゴア副大統領やオバマ夫人、マイケル・サンデル教授やジェームズ・キャメロン監督......などなどの著名人も多数登壇しています。

その中から、今回の「人工知能の脅威」についてトークしているプレゼンを3つご紹介します。動画には全て日本語字幕が付いています! 日本語スクリプトは同記載のサイトにあります。

笑えるポイントもあるし、文字で読むより分かりやすいかもしれません。できれば掲載順に視聴して頂けると良いと思います。

グラディ・ブーチ

「人工知能が人間を超えるのを怖れることはない」

サム・ハリス

「人間より優れた人工知能を作って制御を失わずにいることは可能か?」

ニック・ボストロム

「コンピュータが人間より知的になったとき何が起きるか?」

【連載記事】

第1回:ロボットとアニメの歴史

第2回:アニメで考えるロボ倫理

第3回:"SAO"に見るAIの種類と汎用人工知能。

第4回:人工知能の開発課題と思考実験

第5回:人工知能と人間はどう付き合うか。

第6回:AIは人間を破滅に導くのか?

第7回:人間、意識、知能、生命とは何か?

第8回:生命、宇宙、万物についての究極の疑問の答え

*1:Ledge.ai「シンギュラリティ(技術的特異点)とは | 研究者の主張・AIによる仕事の変化」2019年7月29日付<https://ledge.ai/singularity/>(2020年7月31日最終閲覧)

*2:松尾豊(2015)『人工知能は人間を超えるか』pp.22-23、KADOKAWA

*3:一色政彦(2019)「シンギュラリティ(Singularity:技術的特異点)とは?」2019年04月15日付、ITmedia<https://www.atmarkit.co.jp/ait/articles/1904/15/news036.html>(2020年7月31日最終閲覧)

*4:Dominique Mosbergen(2014)「ホーキング博士「人工知能の進化は人類の終焉を意味する」」2014年12月04日付、Huffington Post<https://www.huffingtonpost.jp/2014/12/03/stephen-hawking-ai-spell-the-end-_n_6266236.html>(2020年7月31日最終閲覧)

*5:Dominique Mosbergen(2014)「ホーキング博士「人工知能の進化は人類の終焉を意味する」」2014年12月04日付、Huffington Post<https://www.huffingtonpost.jp/2014/12/03/stephen-hawking-ai-spell-the-end-_n_6266236.html>(2020年7月31日最終閲覧)

*6:産経ニュース「人工知能=AI開発 ゲイツ氏も「危険」 過熱する「AIは人類を滅ぼすか」論争」2015年2月11日付<https://www.sankei.com/premium/news/150211/prm1502110001-n1.html(2020年7月31日最終閲覧)>

*7:前田真希子(2015)「スティーブ・ウォズニアックが語る。「いつか人間はロボットのペットになるよ」」2015年7月1日、Gizmodo<https://www.gizmodo.jp/2015/07/post_17495.html>(2020年7月31日最終閲覧)

*8:WIRED「ラク・オバマが伊藤穰一に語った未来への希望と懸念すべきいくつかのこと」2016年12月10日付<https://wired.jp/special/2016/barack-obama/>(2020年7月31日最終閲覧)

*9:CNN「AIを制する国が「世界を支配」、プーチン大統領が持論展開」2017年9月4日<https://www.cnn.co.jp/tech/35106734.html>(2020年7月31日最終閲覧)

*10:GIGAZINE「「AI脅威説は無責任」というマーク・ザッカーバーグに対してイーロン・マスクが反論するバトル」2017年7月26日付<https://gigazine.net/news/20170726-ai-fearmongering-debate/>(2020年7月31日最終閲覧)

*11:Anthony Ha(2018)「エリック・シュミットが、イーロン・マスクはAIについて「完全に間違っている」と語った」2018年5月27日付、TechCrunch<https://jp.techcrunch.com/2018/05/27/2018-05-25-eric-schmidt-musk-exactly-wrong/>(2020年7月31日最終閲覧)

*12:松原仁「アシロマの人工知能23原則 」イミダス<https://imidas.jp/genre/detail/K-102-0202.html>(2020年7月31日最終閲覧)

*13:東京海上研究所「AIの安全ガイドライン「アシロマ AI 23原則」」『SENSOR』東京海上研究所ニュースレター<https://www.tmresearch.co.jp/sensor/wp-content/uploads/sites/2/2017/03/SENSOR35.pdf>(2020年7月31日最終閲覧)

*14:人工知能学会(2017)「「人工知能学会 倫理指針」について」<http://ai-elsi.org/report/ethical_guidlines>(2020年7月31日最終閲覧)

*15:人工知能学会倫理委員会(2017)「人工知能学会 倫理指針」<http://ai-elsi.org/wp-content/uploads/2017/02/%E4%BA%BA%E5%B7%A5%E7%9F%A5%E8%83%BD%E5%AD%A6%E4%BC%9A%E5%80%AB%E7%90%86%E6%8C%87%E9%87%9D.pdf>(2020年7月31日最終閲覧)

*16:大内佐紀(2019)「AI兵器が「一線」を越えると……」2019年5月1日付、読売新聞オンライン<https://www.yomiuri.co.jp/feature/quarterly/20190424-OYT8T50091/>(2020年7月31日最終閲覧)

*17:WIRED「人工知能は「第2の核兵器」になるかもしれない──「自動化された戦争」を避けるためにすべきこと」2017年9月10日付<https://wired.jp/2017/09/10/ai-could-revolutionize-war/>(2020年7月31日最終閲覧)

*18:WIRED「核に代わる「人工知能の軍事利用」、米中露3国の開発レースの現状」2017年9月19日付<https://wired.jp/2017/09/19/artificial-intelligence-fuels/>(2020年7月31日最終閲覧)

*19:渡部悦和(2017)「中国人民解放軍が進める「AI軍事革命」は北のミサイルより恐ろしい」2017年12月28日付、現代新書、講談社<https://gendai.ismedia.jp/articles/-/53869>(2020年7月31日付)

*20:BuzzFeed「シリコンバレーが警告するAIの恐怖、その本質を「メッセージ」原作者が分析」2018年1月14日付<https://www.buzzfeed.com/jp/tedchiang/the-real-danger-to-civilization-isnt-ai-its-runaway-1>(2020年7月31日最終閲覧)

*21:ユヴァル・ノア・ハラリ著、柴田裕之訳(2018)『ホモ・デウス テクノロジーとサピエンスの未来』p.159、河出書房新社